ที่มา: Sina Technology Synthesis

การใช้กล้องตัวเดียวในการถ่ายภาพเบลอนั้นไม่ใช่เรื่องใหม่อีกต่อไปiPhone XRและก่อนหน้านั้นGoogle Pixel 2มีความพยายามที่คล้ายคลึงกัน

iPhone SE ใหม่ของ Apple ก็เหมือนกัน แต่กล้ององค์ประกอบเก่าเกินไป เครดิตหลักยังอยู่ในอัลกอริทึม

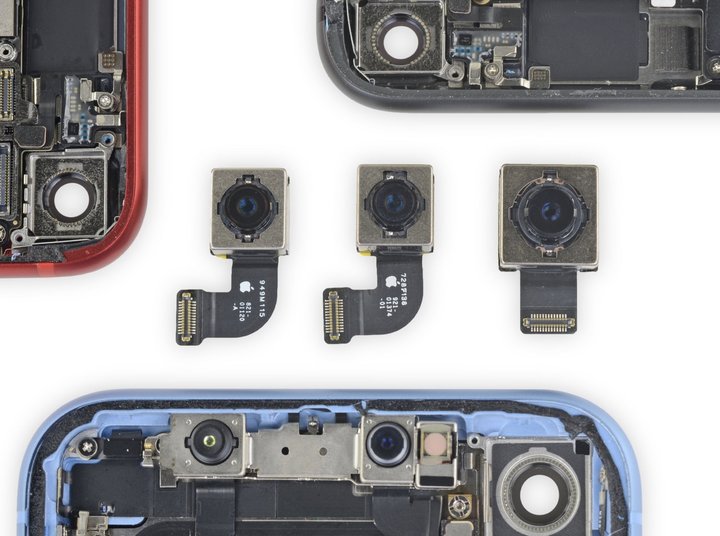

จากรายงานการถอดประกอบของ iFixit จะเห็นได้ว่าบางส่วนของ iPhone SE ใหม่มีความสอดคล้องกับiPhone 8แม้จะสามารถใช้แทนกันได้ รวมถึงมุมกว้าง 12 ล้านพิกเซลกล้อง .

การฝึกฝน 'ไวน์ใหม่ในขวดเก่า' ไม่ใช่เรื่องแปลกสำหรับ iPhone SEย้อนกลับไปเมื่อ 4 ปีที่แล้ว iPhone SE รุ่นแรกยังใช้รูปลักษณ์ของ 5s และฮาร์ดแวร์ส่วนใหญ่ ดังนั้น Apple สามารถให้ราคาที่ต่ำกว่าได้

ในทางทฤษฎี เมื่อคัดลอกฮาร์ดแวร์กล้องตัวเดียวกันกล้องลักษณะของทั้งสองไม่ควรแตกต่างกันมากนักตัวอย่างเช่น,iPhone 8ไม่รองรับการถ่ายภาพระยะชัดลึกเล็กน้อยโดยมีวัตถุชัดเจนและพื้นหลังเบลอ ซึ่งเรามักเรียกว่า "โหมดแนวตั้ง"

แต่เมื่อคุณดูที่หน้าสนับสนุนของ Apple คุณจะพบว่าโหมดแนวตั้งที่ .ไม่รองรับiPhone 8ได้รับการสนับสนุนโดย iPhone SE ใหม่แม้ว่าข้อกำหนดเลนส์ด้านหลังของทั้งสองจะเหมือนกันทุกประการ

ภายใต้สถานการณ์ปกติ การถ่ายภาพเบลอด้วยโทรศัพท์มือถือมักจะต้องใช้กล้องคู่ เช่นเดียวกับดวงตาของมนุษย์ โทรศัพท์มือถือยังต้องได้ภาพสองภาพในมุมที่ต่างกันผ่านเลนส์สองตัวที่ตำแหน่งต่างกัน แล้วจึงรวมมุมของ view ความแตกต่างจะประมาณระยะชัดลึกเพื่อให้ฉากหลังเบลอและทำให้ตัวแบบชัดเจน

ซีรีย์ Plus ในรายการหรือ X, XS และ 11 ในช่วงไม่กี่ปีที่ผ่านมานั้นใช้ระบบกล้องหลายตัวในการถ่ายภาพพอร์ตเทรตเบลอ

แล้วกล้องหน้าเดียวของ iPhone แก้ปัญหายังไง?แกนกลางอยู่ในโปรเจ็กเตอร์ดอทเมทริกซ์อินฟราเรดในระบบ Face ID ซึ่งสามารถรับข้อมูลความลึกที่แม่นยำเพียงพอ ซึ่งเทียบเท่ากับ 'เลนส์เสริม'

จากมุมมองนี้ iPhone SE สามารถถ่ายภาพในโหมดแนวตั้งได้เป็นพิเศษ: ครั้งแรก ไม่ใช้หลายช็อต ประการที่สอง ไม่มี Face ID โดยทั่วไปไม่มีความเป็นไปได้ของการสนับสนุนฮาร์ดแวร์

เห็นได้ชัดว่า Apple ได้ทำการเปลี่ยนแปลงบางอย่างที่เรามองไม่เห็นในระดับซอฟต์แวร์

เมื่อเร็วๆ นี้ Ben Sandofsky ผู้พัฒนาแอปพลิเคชั่นกล้องของบริษัทอื่น Halide ได้เปิดเผยหลักการทางเทคนิค โดยอธิบายว่าทำไม iPhone SE ใหม่จึงใช้สเปกเลนส์เดี่ยวแบบเดียวกับที่iPhone 8แต่สามารถบรรลุโหมดภาพถ่ายพอร์ตเทรตที่โหมดหลังทำไม่ได้

พวกเขากล่าวว่า iPhone SE ใหม่น่าจะเป็น 'iPhone เครื่องแรกที่สามารถสร้างเอฟเฟกต์เบลอภาพบุคคลโดยใช้ภาพ 2D เพียงภาพเดียว'

คุณอาจพูดได้ว่าiPhone XRยังไม่ใช่ภาพเบลอจากกล้องตัวเดียวไม่ใช่ SE เพียงแค่คัดลอกหรือไม่

อย่างไรก็ตาม สถานการณ์การรื้อถอนได้พิสูจน์แล้วว่ากล้องของ iPhone SE และiPhone XRไม่สอดคล้องกันซึ่งนำไปสู่ความแตกต่างในการใช้งานทางเทคนิคของทั้งสอง

▲Samsung Galaxy S7ซีรีส์เป็นอุปกรณ์แรกที่ใช้เทคโนโลยี DPAF บนสมาร์ทโฟนกล้อง

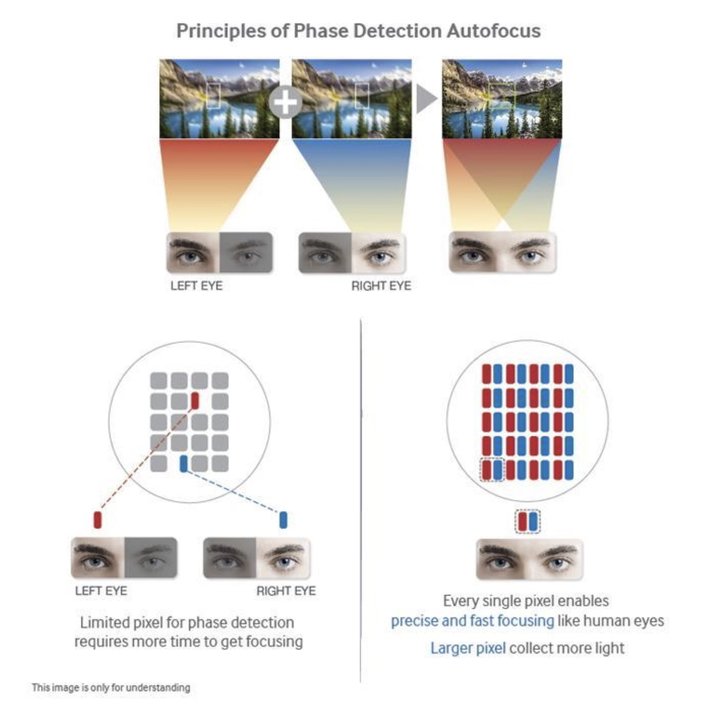

จุดที่สำคัญที่สุดก็คือกล้องของiPhone XRสามารถใช้เทคโนโลยีโฟกัสอัตโนมัติแบบสองพิกเซล (DPAF) ซึ่งช่วยให้สามารถรับข้อมูลเชิงลึกบางอย่างตามฮาร์ดแวร์ได้

กล่าวง่ายๆ เทคโนโลยี DPAF เทียบเท่ากับการแบ่งพิกเซลบนกล้องเซ็นเซอร์เป็นพิกเซลเล็กๆ เคียงข้างกัน 2 พิกเซลที่เล็กกว่าเพื่อถ่ายภาพสองภาพในมุมที่ต่างกัน เช่นเดียวกับตาซ้ายและขวาของเรา

แม้ว่าความแตกต่างของมุมที่เกิดจากสิ่งนี้จะไม่ชัดเจนเท่าของ dualกล้องยังคงเอื้อต่ออัลกอริทึมในการสร้างข้อมูลเชิงลึก

▲Google Pixel 2, 3แผนที่ความเหลื่อมล้ำสองแผนที่ที่ได้รับโดยใช้เทคโนโลยี DPAF นั้นยากต่อการมองเห็นด้วยตาเปล่า

รับรู้แต่ยังสามารถช่วยให้อัลกอริธึมการแบ่งส่วนภาพตัดสินใจได้

ก่อนหน้านี้,Googleก็ใช้เทคโนโลยีนี้ในพิกเซล 2, 3เพื่อให้ได้ภาพเบลอในช็อตเดียวบนPixel4 เนื่องจากกล้องถูกแทนที่ด้วยข้อกำหนดสำหรับกล้องหลายตัว การตรวจจับพารัลแลกซ์จึงมีความแม่นยำมากกว่ากล้องเดี่ยวอย่างมาก

▲ มาดูข้อมูลที่ได้รับจาก Pixel 4 โดยใช้กล้องสองตัวกัน

สำหรับ iPhone SE ใหม่เนื่องจากเซ็นเซอร์เก่าเกินไป Halide อ้างว่าไม่สามารถพึ่งพาเซ็นเซอร์เพื่อรับแผนที่ที่ไม่เท่าเทียมกันและโดยทั่วไปสามารถพึ่งพาอัลกอริธึมการเรียนรู้ของเครื่องที่ชิป A13 Bionic ให้มาเพื่อจำลองและสร้างข้อมูลเชิงลึกเท่านั้น แผนที่

คำอธิบายหนึ่งประโยคคือ การถ่ายภาพเบลอแนวตั้งของ iPhone SE ทำได้โดยซอฟต์แวร์และอัลกอริธึมทั้งหมด

▲ ถ่ายรูปนี้โดยตรงกับiPhone XRและ iPhone SE . ใหม่

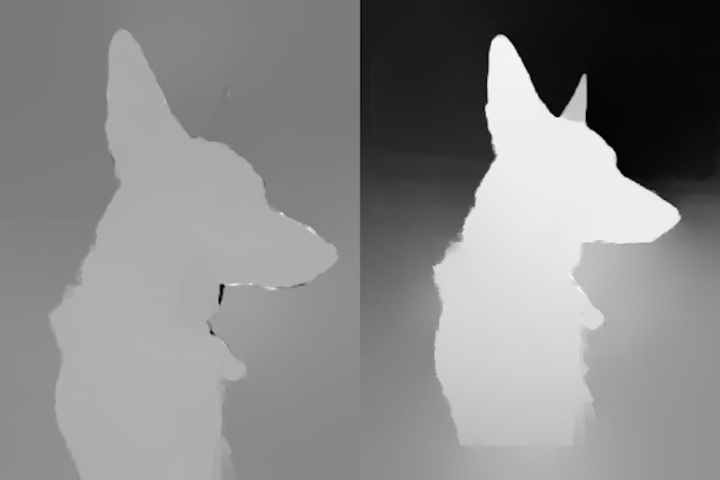

▲ กราฟข้อมูลความลึกiPhone XRทางด้านซ้าย iPhone SE ใหม่ทางด้านขวา

แต่ใน iPhone SE ใหม่ด้วยอัลกอริธึมใหม่จากชิป A13 เราได้แผนที่ความลึกที่แตกต่างอย่างสิ้นเชิงจากXR.ไม่เพียงแต่จดจำหูของลูกสุนัขและโครงร่างโดยรวมได้อย่างถูกต้อง แต่ยังประมวลผลเป็นชั้นๆ สำหรับพื้นหลังที่แตกต่างกันด้วย

แผนที่เชิงลึกประเภทนี้ไม่ถูกต้อง 100%Halide กล่าวว่าความแม่นยำของการคัตเอาท์และการเบลอของ iPhone SE ใหม่เมื่อถ่ายภาพเบลอแบบไม่ต้องเผชิญกับใบหน้านั้นไม่แม่นยำเท่ากับเมื่อถ่ายภาพบุคคล

โดยเฉพาะอย่างยิ่งในกรณีที่วัตถุและภาพพื้นหลังบางภาพเบลอมาก ประโยชน์ของกล้องหลายตัวจะชัดเจนขึ้นในเวลานี้

▲ ในรูปแบบ non-face แบบนี้ ตัวแบบและฉากหลังไม่แยกจากกัน เบลอของ iPhone SE ใหม่

ผิดพลาดได้ง่าย

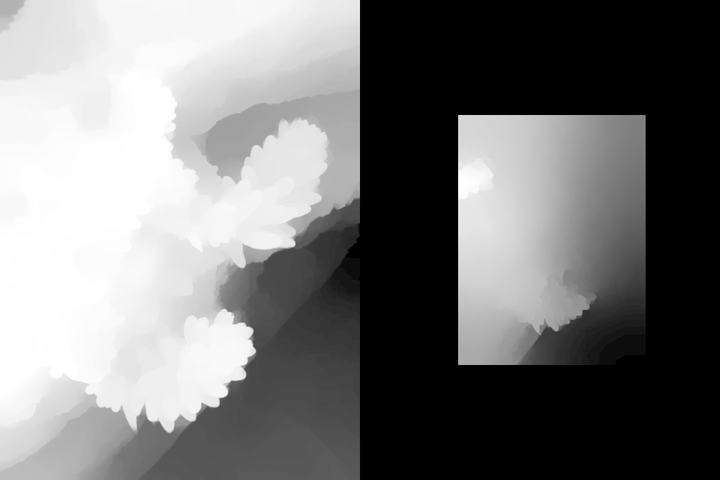

ดังที่คุณเห็นจากภาพนี้iPhone 11 Proที่ติดตั้งระบบกล้องหลายตัว ไม่เพียงแต่สามารถร่างโครงร่างพืชขนาดเล็กบนท่อนซุงได้อย่างสมบูรณ์เท่านั้น แต่ยังสามารถรับรู้ระยะห่างของพื้นหลังและประมวลผลเป็นชั้นๆ ได้อีกด้วย

▲ กราฟข้อมูลความลึกiPhone 11 Proทางด้านซ้าย iPhone SE ใหม่ทางด้านขวา

ใน iPhone SE ใหม่ แม้จะมีผลลัพธ์จากการประมวลผลแบบหลายชั้นเหมือนกัน แต่ตัวแบบและพื้นหลังก็ถูกหลอมรวมเข้าด้วยกันอย่างสมบูรณ์โดยธรรมชาติแล้ว กระบวนการหลังการเบลอจะเลวร้ายยิ่งกว่ากระบวนการiPhone 11 Pro.

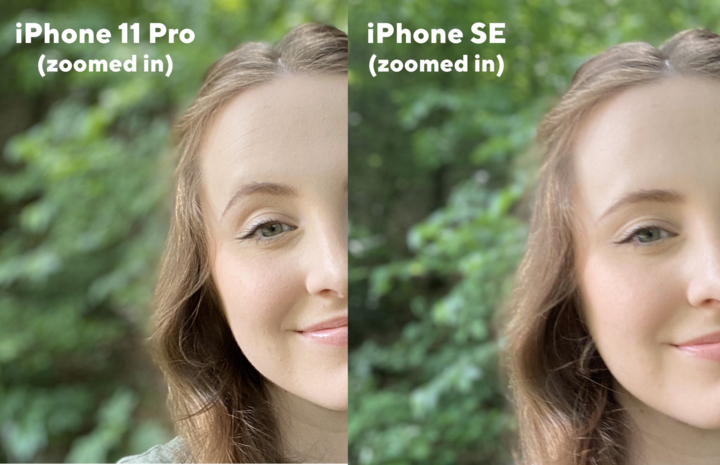

▲ หลักฐานที่เบลอจริงiPhone 11 Proทางด้านซ้ายและ iPhone SE ใหม่ทางด้านขวา

นั่นเป็นเหตุผลที่เมื่อ iPhone SE ใหม่ใช้ iOS ของตัวเองกล้องเฉพาะเมื่อตรวจพบใบหน้ามนุษย์เท่านั้นที่สามารถเปิดใช้งาน "โหมดแนวตั้ง" เพื่อถ่ายภาพเบลอได้ในกรณีอื่นๆ ข้อผิดพลาดจะปรากฏขึ้น

เหตุผลยังคงเกี่ยวข้องกับอัลกอริทึมของ AppleHalide กล่าวถึงเทคนิคที่เรียกว่า 'Portrait Effects Matte' (Portrait Effects Matte) ซึ่งส่วนใหญ่ใช้เพื่อค้นหาโครงร่างที่แม่นยำของผู้คนในภาพถ่ายในโหมดแนวตั้ง รวมถึงรายละเอียดต่างๆ เช่น เส้นผมที่ขอบ กรอบแว่น เป็นต้น ตัวแบบและพื้นหลัง จะถูกแบ่งส่วน

แต่ในปัจจุบัน เทคโนโลยีการแบ่งกลุ่มชุดนี้ตามแมชชีนเลิร์นนิงได้เตรียมพร้อมสำหรับ "การยิงคน" มากขึ้น มันสามารถชดเชยการขาดข้อมูลพารัลแลกซ์ในซิงเกิ้ลได้กล้องโทรศัพท์เช่นiPhone XRและ iPhone SE แต่ถ้าหัวเรื่อง อัลกอริธึมจะทำให้การตัดสินผิดพลาดเมื่อเปลี่ยนอักขระจากวัตถุอื่น

สำหรับโทรศัพท์ที่มีกล้องหลายตัวเช่นiPhone 11 Proคุณสามารถรับข้อมูลพารัลแลกซ์ได้โดยตรงผ่านกล้องฮาร์ดแวร์ ดังนั้นพวกเขาจึงสามารถใช้โหมดแนวตั้งในฉากที่ไม่ใช่ใบหน้าเมื่อใช้ของตัวเองกล้อง.

▲ เลนส์ด้านหน้าของ iPhone SE ใหม่ยังรองรับโหมดแนวตั้งและความแม่นยำของใบหน้าสูงมาก

และความแตกต่างของภาพก็อยู่ที่เอฟเฟ็กต์โบเก้เท่านั้น

แน่นอน นักพัฒนาบุคคลที่สามยังคงสามารถใช้สิ่งที่ไม่ได้รับการสนับสนุนอย่างเป็นทางการตอนนี้แอป Halide สามารถรองรับได้iPhone XR, SE เพื่อถ่ายภาพเบลอของสัตว์ขนาดเล็กหรือวัตถุอื่นๆในความเป็นจริง มันยังใช้เทคโนโลยีมาสก์ภาพเหมือนของ Apple เพื่อรับแผนที่เชิงลึก แล้วเพิ่มการเพิ่มประสิทธิภาพแบ็คเอนด์ของตัวเองเพื่อให้บรรลุ

▲ การใช้แอพของบริษัทอื่นอย่าง Halide คุณสามารถใช้ iPhone SE ใหม่เพื่อถ่ายภาพเบลอของวัตถุที่ไม่ใช่ใบหน้าได้

โดยทั่วไป การเบลอภาพบุคคลจาก iPhone SE ใหม่นี้เป็นขีดจำกัดที่ทำได้โดยการปรับซอฟต์แวร์ให้เหมาะสมสำหรับโทรศัพท์ที่มีกล้องเดี่ยวจริงๆ แล้วนี่เป็นเพราะชิป A13หากไม่ได้นำอัลกอริธึมการเรียนรู้ของเครื่องล่าสุดกล้องประสบการณ์คนเดียวประสบการณ์การถ่ายภาพ SE อย่างเห็นได้ชัดต้องครึ่งเดียว

ดังนั้นจึงยังคงมีความหมายสำหรับสมาร์ทโฟนในการพัฒนาระบบกล้องหลายตัวเราสามารถใช้มุมกว้างพิเศษเพื่อขยายมุมมองภาพ และเราสามารถพึ่งพาเลนส์เทเลโฟโต้เพื่อให้ได้ภาพซูมที่ไม่ทำลายล้างความช่วยเหลือในการตรวจจับความเป็นจริงเสริม สิ่งเหล่านี้ไม่ได้ทำได้โดยการอัพเกรด OTA หรือการบดอัลกอริธึมเท่านั้น

แน่นอนว่า การโอ้อวดและแย่งชิงจำนวนกล้องก็เป็นเรื่องที่น่ารำคาญเช่นกันหากฮาร์ดแวร์กำหนดเฉพาะขีดจำกัดล่างของการสร้างภาพ ชุดของอัลกอริธึมที่ยอดเยี่ยมสามารถเพิ่มขีดจำกัดบนของการถ่ายภาพได้อย่างมาก และแม้กระทั่งแสดงค่าและมูลค่าของฮาร์ดแวร์เก่าอีกครั้งศักยภาพ.

ฉันไม่รู้ว่าเราจะรออีกสี่ปีได้ไหมเมื่อ iPhone SE รุ่นต่อไปออกมา จะโสดกล้องยังคงมีสถานที่ในอุตสาหกรรมโทรศัพท์มือถือ?

Post time: May-06-2020