Fonte: Sina Technology Synthesis

O uso de uma única câmera para obter uma fotografia desfocada não é novidade, o anterioriPhone XRe mais cedoGoogle Pixel 2tiveram tentativas semelhantes.

O novo iPhone SE da Apple também é o mesmo, mas seuCâmeraelemento é muito antigo, o crédito principal ainda está no algoritmo.

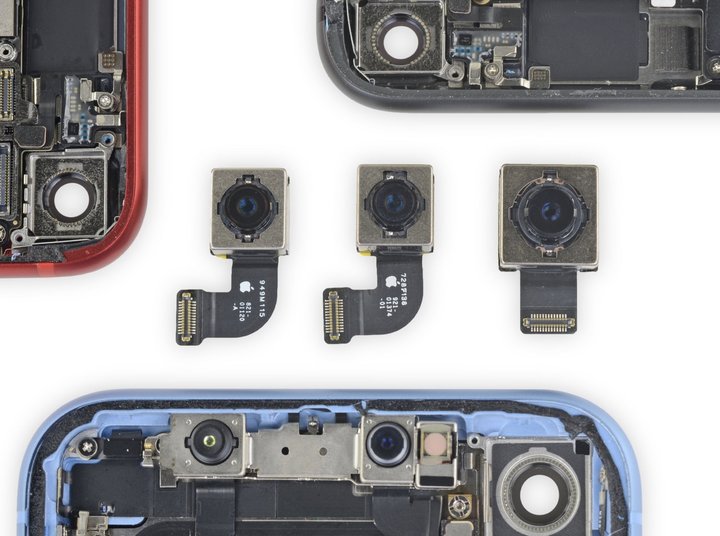

A partir do relatório de desmontagem do iFixit, podemos ver que algumas peças do novo iPhone SE são completamente consistentes com oiPhone8, mesmo na medida em que podem ser usados alternadamente - incluindo o grande angular de 12 megapixelsCâmera .

A prática de 'vinho novo em garrafas velhas' não é incomum para o iPhone SE.De volta a quatro anos atrás, a primeira geração do iPhone SE também aplicou a aparência do 5s e a maior parte do hardware, para que a Apple possa oferecer um preço mais baixo.

Teoricamente, ao copiar o mesmo hardware da câmera, oCâmeracaracterísticas dos dois não devem ser muito diferentes.Por exemplo,iPhone8não suporta tirar fotos de pequena profundidade de campo com um assunto nítido e um fundo desfocado, que é o que costumamos chamar de "modo retrato".

Mas quando você olhar para a página de suporte da Apple, você descobrirá que o modo retrato que não é suportado peloiPhone8é suportado pelo novo iPhone SE, mesmo que as especificações da lente traseira dos dois sejam exatamente as mesmas.

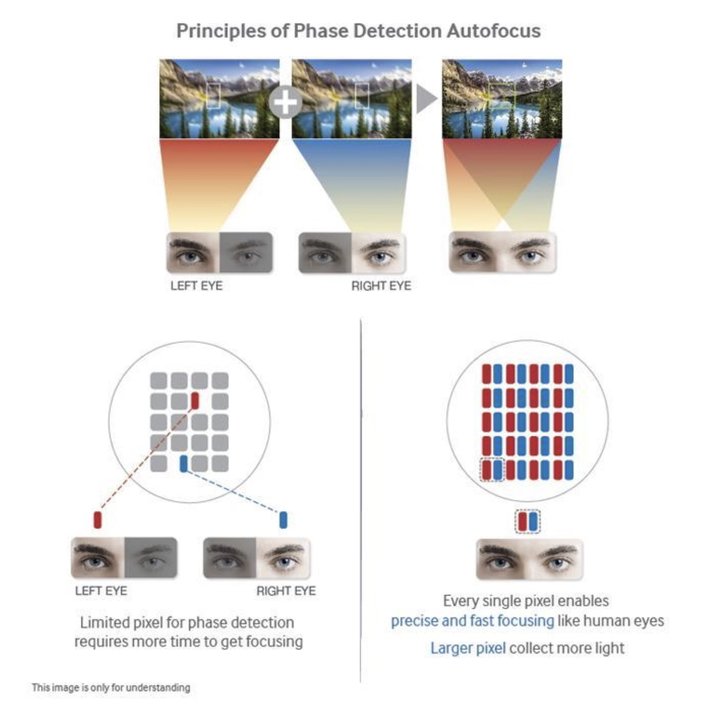

Em circunstâncias normais, tirar fotos desfocadas em um celular geralmente precisa ser feito por câmeras duplas - assim como os olhos humanos, o celular também precisa obter duas imagens em ângulos diferentes através de duas lentes em posições diferentes e, em seguida, combinar os ângulos de view A diferença estima a profundidade de campo para obter o desfoque do fundo e manter o assunto nítido.

A série Plus na lista, ou o X, XS e 11 nos últimos anos, basicamente dependem de sistemas de várias câmeras para concluir a captura de retratos com desfoque.

Então, como a câmera frontal única do iPhone resolve?O núcleo está no projetor de matriz de pontos infravermelho no sistema Face ID, que também pode obter dados de profundidade suficientemente precisos, o que equivale a uma 'lente auxiliar'.

Deste ponto de vista, o iPhone SE pode tirar fotos no modo retrato é muito especial: primeiro, não tira várias fotos, segundo, não possui Face ID, basicamente não há possibilidade de suporte de hardware.

Aparentemente, a Apple fez algumas alterações que não podemos ver ao nível do software.

Recentemente, Ben Sandofsky, o desenvolvedor do aplicativo de câmera de terceiros Halide, revelou os princípios técnicos, explicando por que o novo iPhone SE usa as mesmas especificações de lente única que oiPhone8, mas pode atingir o modo de foto retrato que o último não consegue.

Eles disseram que o novo iPhone SE provavelmente será "o primeiro iPhone que pode gerar um efeito de desfoque de retrato usando apenas uma única imagem 2D".

Você pode dizer que oiPhone XRtambém não é um borrão de câmera única.O SE não está apenas copiando?

No entanto, a situação de desmantelamento provou que amáquinas fotográficasdo iPhone SE eiPhone XRnão são consistentes, o que também leva a diferenças na implementação técnica dos dois.

▲Samsung Galaxy S7series é o primeiro dispositivo que usa a tecnologia DPAF no smartphoneCâmera

O ponto mais importante é que oCâmeradoiPhone XRpode usar a tecnologia de foco automático de pixel duplo (DPAF), que permite obter certos dados de profundidade com base no hardware.

Em termos simples, a tecnologia DPAF equivale a dividir o pixel noCâmerasensor em dois pixels menores lado a lado para capturar duas fotos com ângulos diferentes, assim como nossos olhos esquerdo e direito.

Embora a diferença de ângulo produzida por isso não seja tão óbvia quanto a da duplaCâmera, ainda é propício para o algoritmo gerar dados de profundidade.

▲Google Pixel 2, 3Dois mapas de disparidade obtidos usando a tecnologia DPAF são difíceis de serem vistos a olho nu

perceber, mas ainda pode ajudar o algoritmo de segmentação de imagem a fazer julgamentos

Anteriormente,Googletambém usou essa tecnologia emPixel 2, 3para obter desfoque de disparo único.NoPixel4, porque a câmera é substituída por uma especificação de várias câmeras, a detecção de paralaxe é significativamente mais precisa do que uma câmera única.

▲ Vamos dar uma olhada nos dados obtidos pelo Pixel 4 usando duas câmeras.

Quanto ao novo iPhone SE, porque seus sensores são muito antigos, a Halide afirma que não pode contar com os sensores para obter mapas de disparidade, e basicamente só pode contar com o algoritmo de aprendizado de máquina fornecido pelo chip A13 Bionic para simular e gerar dados de profundidade mapas.

Uma explicação de frase é que o disparo de desfoque de retrato do iPhone SE é inteiramente alcançado por software e algoritmos.

▲ Tire esta foto diretamente comiPhone XRe novo iPhone SE

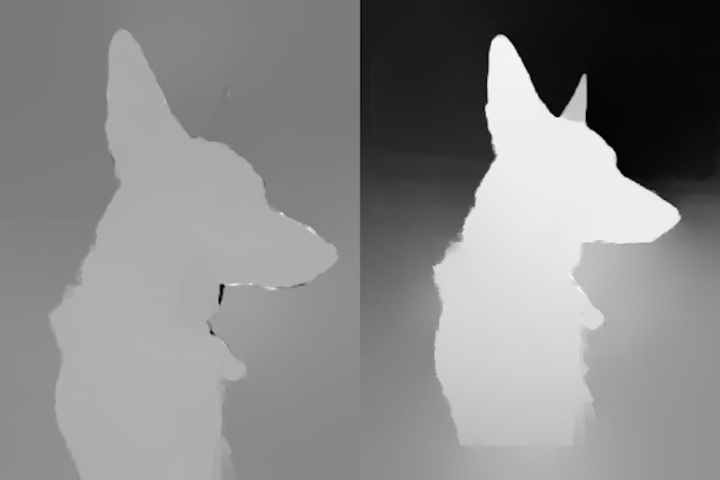

Haleto usou oiPhone XRe o novo iPhone SE para tirar uma foto do filhote (não uma foto real, apenas para tirar uma foto de 'uma foto'), e então comparar os dados de profundidade das duas fotos.

Eles descobriram que oiPhone XRapenas fez uma segmentação de imagem simples para retirar o corpo principal, mas não reconheceu corretamente a orelha do filhote.

▲ Gráfico de dados de profundidade,iPhone XRà esquerda, novo iPhone SE à direita

Mas no novo iPhone SE, com o novo algoritmo fornecido pelo chip A13, conseguimos um mapa de profundidade completamente diferente doXR.Ele não apenas reconhece corretamente as orelhas e o contorno geral do filhote, mas também faz o processamento em camadas para diferentes origens.

Este tipo de mapa de profundidade não é 100% preciso.Halide disse que a precisão do recorte e desfoque do novo iPhone SE ao tirar fotos borradas sem rosto não é tão precisa quanto ao tirar retratos.

Especialmente no caso de alguns assuntos e imagens de fundo ficarem muito desfocados, a vantagem de várias câmeras será mais óbvia neste momento.

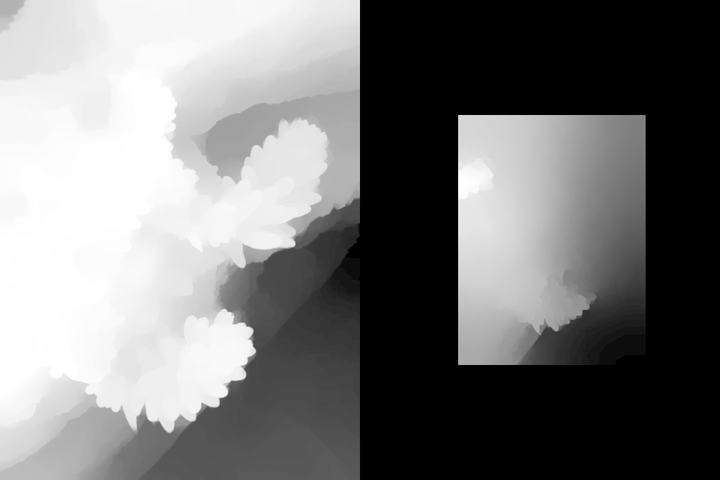

▲ Nesse tipo de tema sem rosto, e o assunto e o fundo não estão claramente separados, o desfoque do novo iPhone SE

é fácil errar

Como você pode ver nesta foto, oiPhone 11Proequipado com um sistema multi-câmera pode não só delinear completamente as pequenas plantas no log, mas também pode reconhecer a distância do fundo e fazer o processamento em camadas.

▲ Gráfico de dados de profundidade,iPhone 11Proà esquerda, novo iPhone SE à direita

No novo iPhone SE, apesar dos mesmos resultados de processamento em camadas, o assunto e o plano de fundo foram completamente fundidos.Naturalmente, o processo de pós-desfoque será naturalmente muito pior do que oiPhone 11Pro.

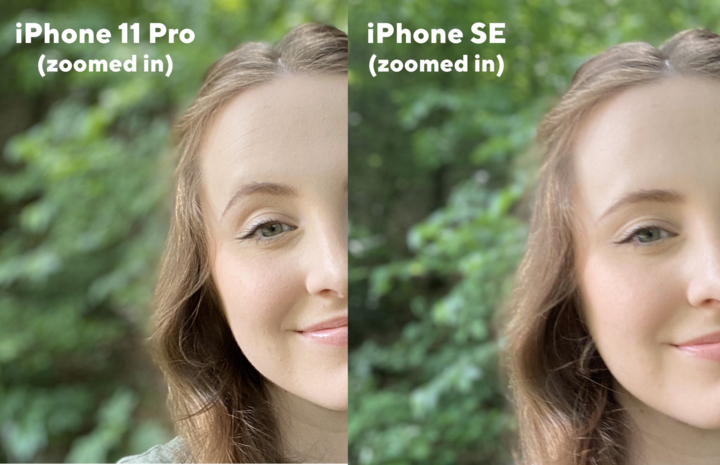

▲ As provas borradas reais,iPhone 11Proà esquerda e o novo iPhone SE à direita

É por isso que, quando o novo iPhone SE usa o próprio iOSCâmeraapp, somente quando um rosto humano é detectado, o "Modo Retrato" pode ser ativado para tirar fotos borradas.Em outros casos, um erro aparecerá.

O motivo ainda está relacionado ao algoritmo da Apple.Halide mencionou uma técnica chamada 'Portrait Effects Matte' (Efeitos de retrato fosco), que é usado principalmente para encontrar o contorno preciso de pessoas em fotos no modo retrato, incluindo detalhes como linha do cabelo na borda, armação de óculos, etc. O assunto e o plano de fundo são segmentados.

Mas, atualmente, esse conjunto de tecnologia de segmentação baseada em aprendizado de máquina está mais preparado para "atirar em pessoas", pode de fato compensar a falta de dados de paralaxe em um únicoCâmeratelefones comoiPhone XRe iPhone SE, mas se o assunto O algoritmo também cometerá um erro de julgamento ao alterar caracteres de outros objetos.

Quanto aos telefones com várias câmeras, comoiPhone 11Pro, você pode obter dados de paralaxe diretamente através doCâmerahardware, para que eles também possam usar o modo retrato em cenas sem rosto ao usar seus própriosCâmera.

▲ A lente frontal do novo iPhone SE também suporta o modo retrato, e a precisão do rosto é muito alta,

e a diferença de imagem está apenas no efeito bokeh

Claro, desenvolvedores de terceiros ainda podem usar coisas que não são oficialmente suportadas.Agora o aplicativo Halide pode suportariPhone XR, SE para tirar fotos desfocadas de pequenos animais ou outros objetos.Na verdade, ele também usa a tecnologia de máscara de retrato da Apple para obter mapas de profundidade e, em seguida, adicionar sua própria otimização de back-end para alcançar.

▲ Usando aplicativos de terceiros como Halide, você pode usar o novo iPhone SE para tirar fotos desfocadas de assuntos que não sejam rostos

Em geral, o desfoque de retrato alcançado por este novo iPhone SE é o limite que pode ser alcançado pela otimização de software para telefones com câmera única.Estritamente falando, isso se deve ao chip A13.Se não trouxesse o mais recente algoritmo de aprendizado de máquina, oCâmeraexperiência por si só, a experiência de filmagem SE obviamente tem que ser metade.

Portanto, ainda é significativo que os smartphones desenvolvam sistemas multicâmera.Podemos usar ultra grande angular para ampliar o campo de visão e podemos contar com a lente telefoto para obter fotos com zoom não destrutivo.Ajuda na detecção de realidade aumentada, isso não é apenas alcançado por uma atualização OTA ou pela trituração de algoritmos.

Claro, gabar-se cegamente e competir pelo número de câmeras também é irritante.Se o hardware determinar apenas o limite inferior da imagem, um conjunto de algoritmos excelentes pode aumentar significativamente o limite superior da imagem e até mesmo reexpressar o valor e o valor do hardware antigo.potencial.

Não sei se podemos esperar mais quatro anos.Quando a próxima geração do iPhone SE for lançada,cameloainda tem um lugar na indústria de telefonia móvel?

Horário da postagem: 06 de maio de 2020