Kilde: Sina Technology Synthesis

Brugen af et enkelt kamera til at opnå sløret fotografering er ikke noget nyt, det tidligereiPhone XRog tidligereGoogle Pixel 2har haft lignende forsøg.

Apples nye iPhone SE er også den samme, men denskameraelementet er for gammelt, er hovedkreditten stadig i algoritmen.

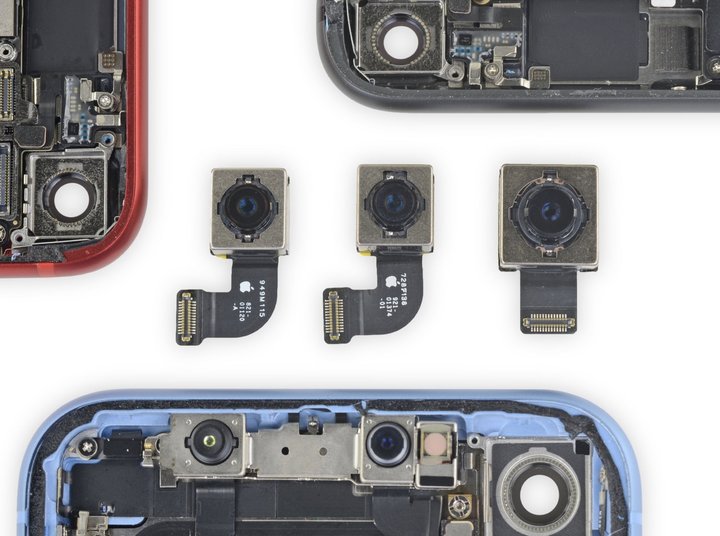

Fra demonteringsrapporten af iFixit kan vi se, at nogle dele i den nye iPhone SE er fuldstændig i overensstemmelse mediPhone 8, selv i det omfang, de kan bruges i flæng - inklusive 12 megapixel vidvinkelkamera .

Praksisen med 'ny vin på gamle flasker' er ikke usædvanlig for iPhone SE.Tilbage til for fire år siden anvendte den første generation af iPhone SE også udseendet af 5s og det meste af hardwaren, så Apple kan give en lavere pris.

Teoretisk set, når du kopierer den samme kamerahardwarekamerakarakteristika for de to bør ikke være meget forskellige.For eksempel,iPhone 8understøtter ikke at tage små dybdeskarphedsbilleder med et klart motiv og en sløret baggrund, som vi ofte kalder "portrættilstand".

Men når du ser på Apples supportside, vil du opdage, at portrættilstanden, der ikke understøttes afiPhone 8understøttes af den nye iPhone SE - selvom specifikationerne for baglinse på de to er nøjagtig de samme.

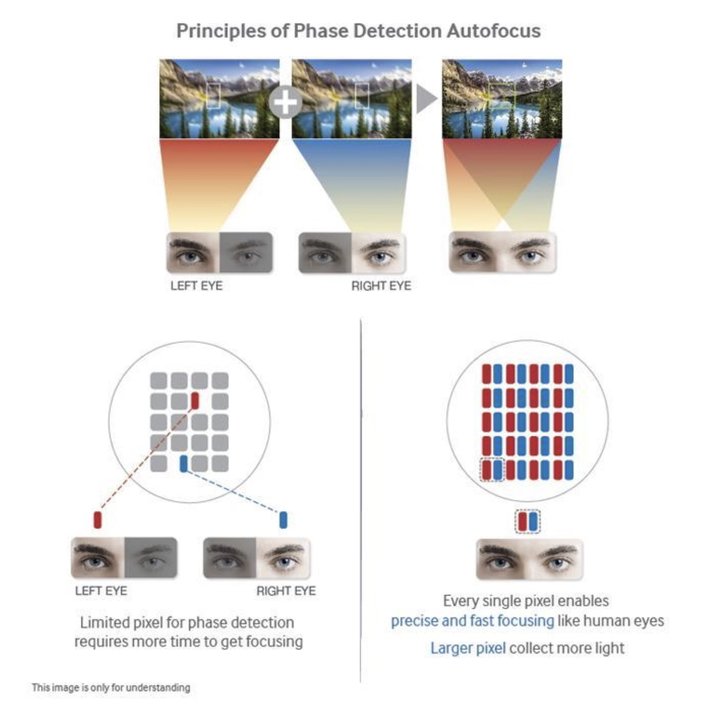

Under normale omstændigheder skal det at tage slørede billeder på en mobiltelefon ofte udføres med to kameraer - ligesom menneskelige øjne skal mobiltelefonen også tage to billeder i forskellige vinkler gennem to linser i forskellige positioner og derefter kombinere vinklerne på view Forskellen estimerer dybdeskarpheden for at opnå baggrundssløring og holde motivet klart.

Plus-serien på listen, eller X, XS og 11 i de seneste år, er dybest set afhængige af multikamerasystemer til at fuldføre portrætsløring.

Så hvordan løser iPhones front enkeltkamera?Kernen ligger i den infrarøde dot matrix-projektor i Face ID-systemet, som også kan opnå tilstrækkelig præcise dybdedata, hvilket svarer til en 'hjælpelinse'.

Fra dette synspunkt, kan iPhone SE tage billeder i portrættilstand, er meget speciel: For det første tager den ikke flere billeder, for det andet har den ikke Face ID, der er dybest set ingen mulighed for hardwaresupport.

Tilsyneladende har Apple lavet nogle ændringer, som vi ikke kan se på softwareniveau.

For nylig afslørede Ben Sandofsky, udvikleren af tredjepartskameraapplikationen Halide, de tekniske principper og forklarer, hvorfor den nye iPhone SE bruger de samme enkeltlinsespecifikationer somiPhone 8, men den kan opnå den portrætfototilstand, som sidstnævnte ikke kan.

De sagde, at den nye iPhone SE sandsynligvis vil være 'den første iPhone, der kan generere en portrætslør-effekt ved kun at bruge et enkelt 2D-billede'.

Man kan sige, atiPhone XRer heller ikke en sløring med et enkelt kamera.Kopierer SE ikke bare det?

Demonteringssituationen har dog bevist, atkameraeraf iPhone SE ogiPhone XRer ikke konsistente, hvilket også fører til forskelle i den tekniske implementering af de to.

▲Samsung Galaxy S7serien er den første enhed, der bruger DPAF-teknologi på smartphonekamera

Den vigtigste pointe er, atkameraafiPhone XRkan bruge dual pixel autofocus (DPAF) teknologi, som gør det muligt at opnå bestemte dybdedata baseret på hardware.

Enkelt sagt svarer DPAF-teknologi til at dividere pixlen påkamerasensor til to mindre side-by-side pixels for at tage to billeder med forskellige vinkler, ligesom vores venstre og højre øje.

Selvom vinkelforskellen frembragt af dette ikke er så indlysende som den for dobbeltkamera, er det stadig befordrende for algoritmen at generere dybdedata.

▲Google Pixel 2, 3To ulighedskort opnået ved hjælp af DPAF-teknologi er vanskelige for det blotte øje

opfatter, men kan stadig hjælpe billedsegmenteringsalgoritmen til at foretage vurderinger

Tidligere,Googleogså brugt denne teknologi påPixel 2, 3for at opnå enkeltbilledeslør.På denPixel4, fordi kameraet er erstattet af en multi-kamera-specifikation, er parallakse-detektion betydeligt mere præcis end enkelt-kamera.

▲ Lad os tage et kig på de data, der er opnået af Pixel 4 ved hjælp af to kameraer.

Med hensyn til den nye iPhone SE, fordi dens sensorer er for gamle, hævder Halide, at den ikke kan stole på sensorerne for at opnå ulighedskort og dybest set kun kan stole på maskinlæringsalgoritmen leveret af A13 Bionic-chippen til at simulere og generere dybdedata Kort.

En sætningsforklaring er, at iPhone SE-portrætsløringsoptagelser udelukkende opnås ved hjælp af software og algoritmer.

▲ Tag dette billede direkte mediPhone XRog ny iPhone SE

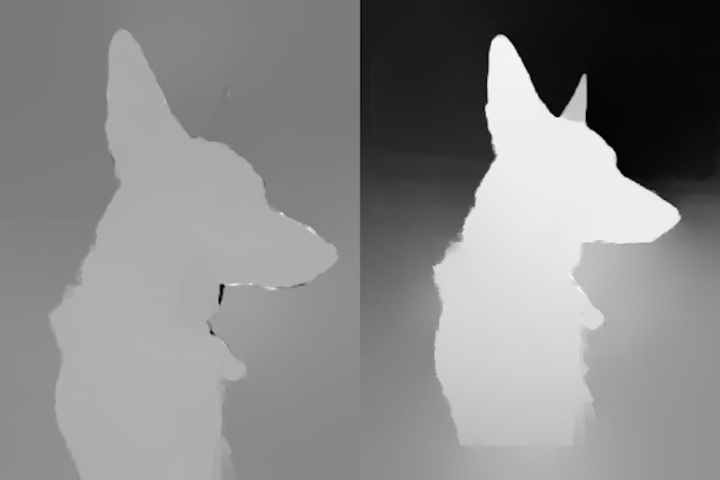

Halide brugteiPhone XRog den nye iPhone SE for at tage et billede af hvalpen (ikke et rigtigt billede, bare for at tage et billede af 'et billede'), og derefter sammenligne dybdedataene for de to billeder.

De fandt ud af, atiPhone XRlavede lige en simpel billedsegmentering for at trække hovedkroppen ud, men genkendte ikke hvalpens øre korrekt.

▲ Dybdedatagraf,iPhone XRtil venstre, ny iPhone SE til højre

Men på den nye iPhone SE, med den nye algoritme leveret af A13-chippen, fik vi et dybdekort, der er helt anderledes endXR.Den genkender ikke kun hvalpens ører og overordnede omrids korrekt, men udfører også lagdelt behandling for forskellige baggrunde.

Denne form for dybdekort er ikke 100 % nøjagtige.Halide sagde, at nøjagtigheden af udskæringen og sløringen af den nye iPhone SE, når du optager slørede billeder uden ansigter, ikke er så nøjagtige, som når du tager portrætter.

Især i det tilfælde, hvor nogle motiver og baggrundsbilleder er meget slørede, vil fordelen ved flere kameraer være mere indlysende på dette tidspunkt.

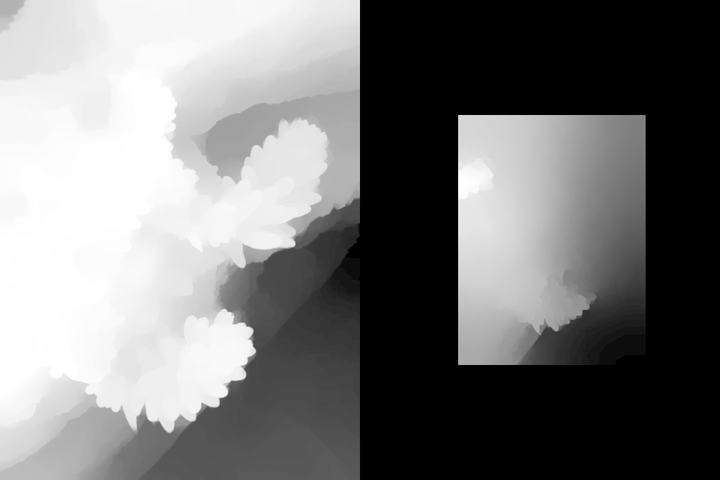

▲ I denne form for ikke-ansigtstema, og motivet og baggrunden ikke er tydeligt adskilt, er sløringen af den nye iPhone SE

er let at lave fejl

Som du kan se på dette billede, eriPhone 11 Proudstyret med et multi-kamera system kan ikke kun fuldstændig skitsere de små planter på loggen, men kan også genkende afstanden til baggrunden og lave lagdelt behandling.

▲ Dybdedatagraf,iPhone 11 Protil venstre, ny iPhone SE til højre

På den nye iPhone SE er motivet og baggrunden blevet fuldstændig smeltet sammen på trods af de samme resultater af lagdelt behandling.Naturligvis vil processen efter sløring naturligvis være meget værre endiPhone 11 Pro.

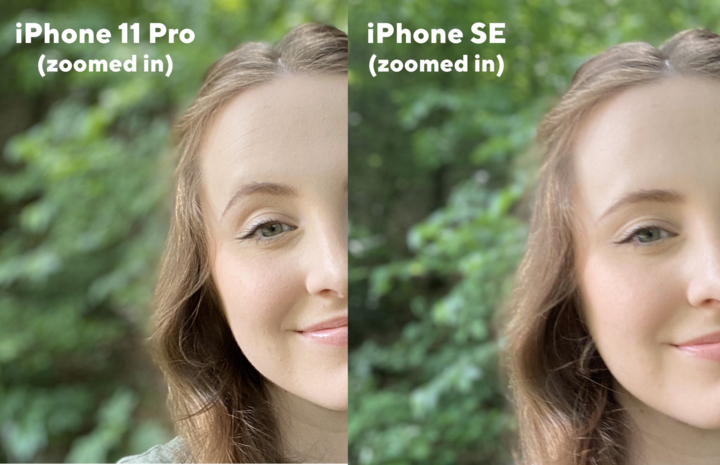

▲ De faktiske slørede beviser,iPhone 11 Protil venstre og den nye iPhone SE til højre

Det er derfor, når den nye iPhone SE bruger iOS's egenkameraapp, kun når et menneskeligt ansigt registreres, kan "Portrættilstand" aktiveres til at tage slørede billeder.I andre tilfælde vil der opstå en fejl.

Årsagen er stadig relateret til Apples algoritme.Halide nævnte en teknik kaldet 'Portrait Effects Matte' (Portrait Effects Matte), som hovedsageligt bruges til at finde de præcise konturer af mennesker i portrætbilleder, herunder detaljer som hårgrænse på kanten, brillestel osv. Motivet og baggrunden er segmenteret.

Men på nuværende tidspunkt er dette sæt segmenteringsteknologi baseret på maskinlæring mere forberedt til at "skyde mennesker", det kan faktisk kompensere for manglen på parallaksedata på enkeltpersonerkameratelefoner som f.eksiPhone XRog iPhone SE, men hvis emnet Algoritmen vil også lave en bedømmelsesfejl ved ændring af tegn fra andre objekter.

Som for multi-kamera telefoner somiPhone 11 Pro, kan du få parallaksedata direkte gennemkamerahardware, så de også kan bruge portrættilstanden i ikke-ansigtsscener, når de bruger deres egnekamera.

▲ Frontlinsen på den nye iPhone SE understøtter også portrættilstanden, og ansigtets præcision er meget høj,

og billedforskellen er kun i bokeh-effekten

Selvfølgelig kan tredjepartsudviklere stadig bruge ting, der ikke er officielt understøttet.Nu kan Halide-appen understøtteiPhone XR, SE for at tage slørede billeder af små dyr eller andre genstande.Faktisk bruger den også Apples portrætmasketeknologi til at opnå dybdekort, og tilføjer derefter sin egen back-end-optimering for at opnå.

▲ Ved at bruge tredjepartsapps som Halide kan du bruge den nye iPhone SE til at tage slørede billeder af ikke-ansigtsmotiver

Generelt er portrætsløringen opnået med denne nye iPhone SE den grænse, der kan opnås ved softwareoptimering til enkeltkameratelefoner.Strengt taget skyldes det faktisk A13-chippen.Hvis det ikke bragte den nyeste maskinlæringsalgoritme,kameraerfaring alene, skal SE-skydeoplevelsen naturligvis være en halv.

Derfor er det stadig meningsfuldt for smartphones at udvikle multikamerasystemer.Vi kan bruge ultravidvinkel til at udvide synsfeltet, og vi kan stole på teleobjektivet til at få ikke-destruktive zoombilleder.Augmented reality-detektionshjælp, disse opnås ikke kun ved en OTA-opgradering eller slibning af algoritmer.

Det er selvfølgelig også irriterende at prale blindt og konkurrere om antallet af kameraer.Hvis hardwaren kun bestemmer den nedre grænse for billeddannelse, så kan et sæt fremragende algoritmer hæve den øvre grænse for billeddannelse markant og endda genudtrykke værdien og værdien af gammel hardware.potentiel.

Jeg ved ikke, om vi kan vente fire år mere.Når den næste generation af iPhone SE kommer ud, vil singlekamerahar du stadig en plads i mobiltelefonindustrien?

Indlægstid: maj-06-2020